在數(shù)字化經(jīng)濟高速發(fā)展的今天,數(shù)據(jù)中心作為信息時代的核心基礎設施,其規(guī)模與處理能力直接決定了上層業(yè)務的效率與可靠性。設計一個能夠支撐單可用區(qū)32萬臺服務器的數(shù)據(jù)中心網(wǎng)絡系統(tǒng),并構(gòu)建與之匹配的高性能數(shù)據(jù)處理服務,是一項涉及網(wǎng)絡架構(gòu)、硬件選型、協(xié)議優(yōu)化和服務編排的復雜系統(tǒng)工程。本文將從網(wǎng)絡系統(tǒng)設計和數(shù)據(jù)處理服務兩個維度,深入探討實現(xiàn)這一目標的核心理念與關(guān)鍵技術(shù)。

一、 超大規(guī)模數(shù)據(jù)中心網(wǎng)絡系統(tǒng)設計

支撐32萬臺服務器的網(wǎng)絡,首要挑戰(zhàn)是突破傳統(tǒng)三層架構(gòu)的瓶頸,實現(xiàn)極致的橫向擴展能力、超低延遲和高吞吐量。

1. 網(wǎng)絡架構(gòu):Clos Spine-Leaf 架構(gòu)的極致演化

基礎架構(gòu): 采用全網(wǎng)狀連接(Full-Mesh)或超大型的Clos(Fat-Tree)架構(gòu)。每個Leaf(接入層)交換機連接服務器,每個Spine(核心層)交換機與所有Leaf交換機全互聯(lián)。通過增加Spine層交換機的數(shù)量,理論上可以無限擴展Leaf交換機和服務器規(guī)模。為支持32萬服務器,需要部署數(shù)百臺高密度、高帶寬的Spine交換機。

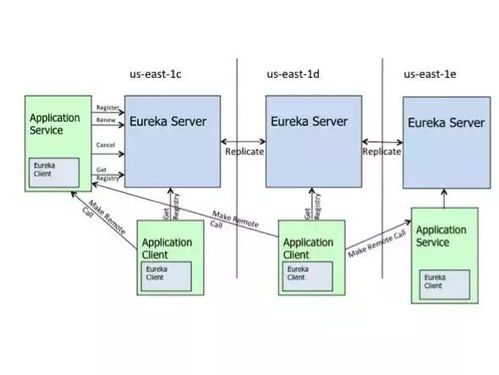

分層與Pod化設計: 將龐大的網(wǎng)絡劃分為多個獨立的Pod或Fabric。每個Pod內(nèi)部是一個完整的Clos網(wǎng)絡,承載數(shù)萬臺服務器。Pod之間通過更高速的Super-Spine層或數(shù)據(jù)中心間互聯(lián)(DCI)設備進行連接。這種“套娃式”分層設計,將廣播域和故障域隔離,極大提升了網(wǎng)絡的可靠性和可管理性。

* 技術(shù)選型: 骨干鏈路全面采用400GbE甚至800GbE光模塊。Leaf交換機采用高密度48口或64口100GbE機型,服務器端普遍配置25GbE或50GbE網(wǎng)卡,確保服務器接入帶寬無瓶頸。

2. 協(xié)議與自動化:軟件定義網(wǎng)絡的深度應用

Underlay網(wǎng)絡: 采用簡潔、穩(wěn)定的協(xié)議如BGP-EVPN(VXLAN封裝)。BGP用于實現(xiàn)大規(guī)模的路由控制和學習,EVPN與VXLAN結(jié)合,在Layer 2和Layer 3上提供覆蓋網(wǎng)絡,實現(xiàn)跨物理機架的大二層域,滿足虛擬機/容器遷移需求,同時保持網(wǎng)絡的高效與可控。

Overlay網(wǎng)絡與SDN控制器: 部署集中式SDN控制器(如基于OpenDaylight或自研)。控制器負責全局網(wǎng)絡視圖、策略下發(fā)(安全組、QoS、負載均衡)、流量工程和自動化運維。所有網(wǎng)絡配置和變更通過控制器API自動化完成,確保數(shù)萬臺設備配置的一致性和快速部署。

* 網(wǎng)絡可視化與智能運維: 集成Telemetry(遙測)技術(shù),實時采集網(wǎng)絡設備的詳細流量、計數(shù)器和狀態(tài)信息,結(jié)合大數(shù)據(jù)分析和AI算法,實現(xiàn)故障預測、根因分析、容量規(guī)劃和性能優(yōu)化,變被動響應為主動運維。

3. 可靠性與容災設計

全冗余設計: 從服務器網(wǎng)卡(雙上聯(lián))、Leaf交換機、Spine交換機到光鏈路,全部實現(xiàn)1:1或N:M冗余。采用多路徑路由(ECMP),實現(xiàn)流量的負載均衡和毫秒級故障切換。

“零信任”安全內(nèi)嵌: 在網(wǎng)絡架構(gòu)中內(nèi)嵌微分段能力。通過SDN策略,即使在同一二層網(wǎng)絡內(nèi),服務器間的訪問也必須經(jīng)過嚴格的身份認證和策略檢查,防止橫向移動攻擊。

二、 面向海量服務器的數(shù)據(jù)處理服務架構(gòu)

強大的網(wǎng)絡是“血管”,而高效的數(shù)據(jù)處理服務則是“心臟”與“大腦”。服務架構(gòu)必須能夠充分利用網(wǎng)絡能力,處理每秒可能高達數(shù)十PB的數(shù)據(jù)流。

1. 微服務與無狀態(tài)化設計

* 將所有數(shù)據(jù)處理服務(如計算引擎、緩存、消息隊列、API網(wǎng)關(guān))設計為無狀態(tài)的微服務。這使得服務實例可以部署在數(shù)據(jù)中心的任意服務器上,并通過負載均衡器(如L4/L7 LB,通常作為SDN的一部分)對外提供統(tǒng)一入口。服務的彈性擴縮容可以快速響應業(yè)務壓力變化。

2. 存儲與計算分離架構(gòu)

* 采用共享存儲架構(gòu)(如分布式文件系統(tǒng)HDFS、Ceph,或?qū)ο蟠鎯ΓS嬎愎?jié)點(運行處理服務)通過網(wǎng)絡(RDMA over Converged Ethernet - RoCE可顯著提升性能)高速訪問存儲集群中的數(shù)據(jù)。這種分離使得計算資源和存儲資源可以獨立擴展,為32萬臺服務器提供了極致的資源利用靈活性。專門的數(shù)據(jù)處理任務(如大數(shù)據(jù)分析、AI訓練)可以動態(tài)申請數(shù)千臺計算服務器組成臨時集群,任務完成后立即釋放。

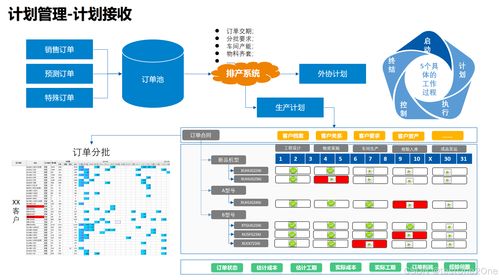

3. 數(shù)據(jù)流與編排系統(tǒng)

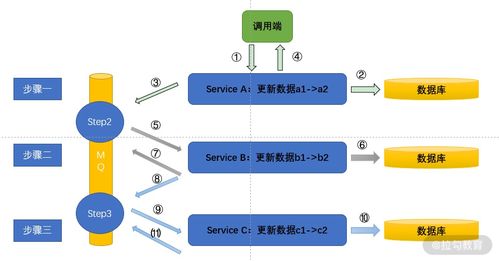

統(tǒng)一數(shù)據(jù)總線: 部署超大規(guī)模分布式消息隊列(如Apache Kafka/Pulsar集群),作為數(shù)據(jù)中心內(nèi)部實時數(shù)據(jù)流的“中樞神經(jīng)系統(tǒng)”,承接日志、指標、事務消息等所有數(shù)據(jù)流,保障數(shù)據(jù)的有序、可靠和低延遲傳輸。

集群編排與管理: 采用Kubernetes等容器編排平臺,管理所有數(shù)據(jù)處理服務的生命周期。結(jié)合數(shù)據(jù)中心資源管理系統(tǒng),實現(xiàn)跨32萬臺服務器的精細化調(diào)度,將任務優(yōu)先調(diào)度到網(wǎng)絡和存儲延遲最低的服務器上,實現(xiàn)“數(shù)據(jù)親和性”。

4. 混合負載管理與服務質(zhì)量保障

* 數(shù)據(jù)中心內(nèi)會同時運行在線服務(低延遲、高可用)和離線作業(yè)(高吞吐、長周期)。通過網(wǎng)絡QoS策略(優(yōu)先級隊列、流量整形)和集群調(diào)度器的協(xié)同,為不同優(yōu)先級的任務分配差異化的網(wǎng)絡帶寬和計算資源,確保核心業(yè)務體驗不受后臺批量作業(yè)影響。

結(jié)論

設計一個支撐單可用區(qū)32萬臺服務器的數(shù)據(jù)中心,其核心在于構(gòu)建一個可線性擴展、高度自動化、智能運維的網(wǎng)絡基礎,以及在其之上部署一個靈活、彈性和高效的數(shù)據(jù)處理服務生態(tài)系統(tǒng)。兩者相輔相成:強大的網(wǎng)絡為數(shù)據(jù)處理提供了高速、穩(wěn)定的“通道”,而云原生的服務架構(gòu)則充分釋放了網(wǎng)絡和硬件資源的潛力。這不僅是技術(shù)的集成,更是架構(gòu)哲學、運維理念和軟件工程能力的全面體現(xiàn),是支撐未來十年數(shù)字世界發(fā)展的堅實基石。